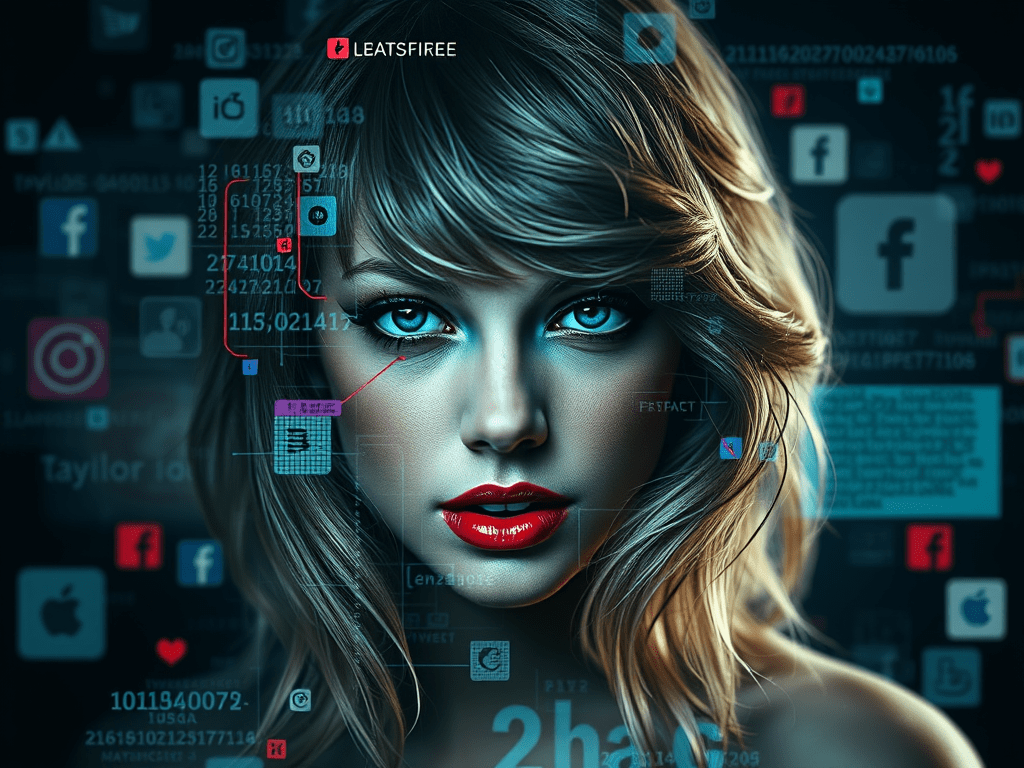

La semaine dernière, en février (2024), de fausses images pornographiques de Taylor Swift, créées grâce à des modèles d’IA, ont enflammé le réseau social X. Initialement publiées sur Telegram et 4chan, ces images ont eu le temps d’être vues 47 millions de fois avant d’être partiellement supprimées de X.

Ces deepfakes – ou hypertrucages – sont des techniques de synthèse multimédia reposant sur l’IA, pouvant servir à superposer ou fusionner des images, des fichiers audio ou vidéo existants sur d’autres fichiers vidéo (e.g. changement de visage d’une personne sur une vidéo), et ainsi créer un contenu artificiel sur une personne. L’essor des solutions d’IA a facilité l’expansion de ce phénomène, qui touche principalement les femmes (96% des deepfakes sont pornographiques et la totalité représente des femmes).

Or, le droit actuel ne permet pas de lutter contre les deepfakes diffusés sans le consentement de la personne représentée, en particulier quand le contenu est pornographique.

Si le code pénal en France sanctionne la publication de montages réalisés sans le consentement de la personne, les principes de légalité et d’interprétation stricte du droit pénal rendent difficiles son éventuelle application aux deepfakes à caractère sexuel. Autre rempart possible: une action civile sur le fondement d’une atteinte au droit à l’image (article 9 du code civil qui protège la vie privée).

Pour contenir ce phénomène, le projet de loi visant à sécuriser et à réguler l’espace numérique prévoit de sanctionner les deepfakes, notamment pornographiques: (i) publier un deepfake représentant les paroles ou l’image d’une personne sans son consentement, et sans qu’il soit clairement établi qu’il s’agit d’un faux sera puni jusqu’à 2 ans de prison et 45 000€ d’amende; et (ii) publier sans consentement des deepfakes pornographiques sera puni jusqu’à 3 ans de prison et 75 000€ d’amende.

En attendant que la loi française pour réguler l’espace numérique soit votée, l’UE propose un timide cadre juridique dans l’IA Act, dont le règlement a été enfin validé la semaine dernière par les pays membres de l’UE. Il prévoit une obligation de transparence pour les utilisateurs d’un système d’IA qui devront préciser les contenus qui ont été générés artificiellement, comme les deepfakes (article 52 IA Act). Une peine inutile quand la vidéo a déjà atteint 47M de vues?

La responsabilisation des réseaux sociaux et des IA génératives est alors indispensable, à l’instar de Microsoft Designer, le générateur d’images par IA de Microsoft, qui a annoncé avoir mis en place de nouvelles protections pour lutter contre les utilisations abusives de ses outils d’IA générative.

Aux Etats-Unis, alors que le Congrès américain a auditionné les dirigeants des principaux réseaux sociaux, plusieurs sénateurs demandent que les médias sociaux soient enfin responsables des contenus qu’ils hébergent. Et en attendant que des poursuites des réseaux soient possibles par un cadre légal, il y a l’humiliation publique de leurs dirigeants, auxquels on demande justement d’empêcher l’humiliation de certains internautes. Histoire sans fin.

Sacha Bettach – Avocat au Barreau de Paris

Laisser un commentaire